随着 NVME SSD 的性能和容量不断提高,且价格不断下降,随着高性能无损网络 25Gb/100Gb 的普及和 400Gb 的出现,随着 NVMe over RoCE 技术的普及(数据中心的任何位置访问存储都只需要微秒级时延),这都加速了全闪化数据中心架构的到来。全闪化数据中心架构能为企业级客户提供显著的性能提升、成本节约和业务灵活性,从而帮助企业在高度竞争的市场环境中取得优势。但现有全闪存储存在以下痛点:

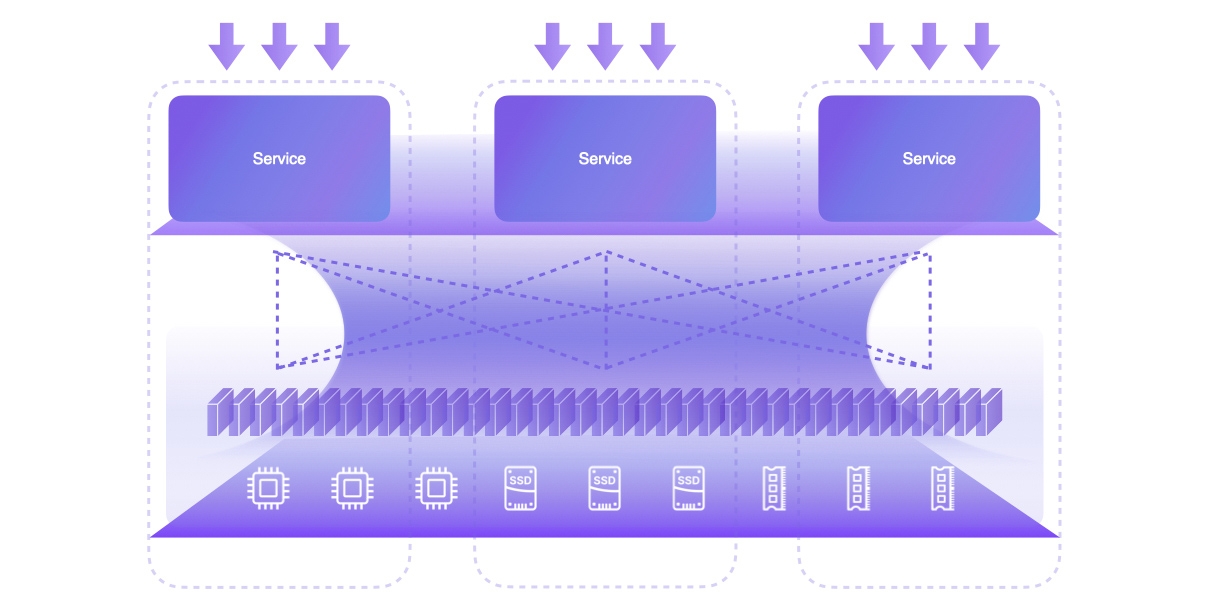

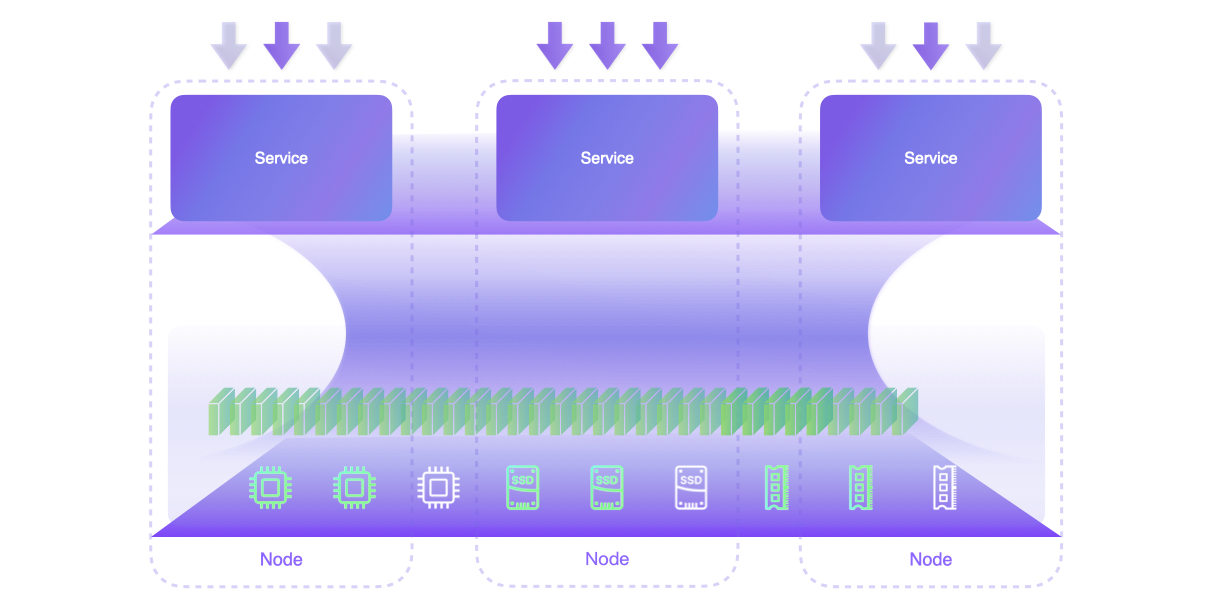

XSKY 通过借鉴高端存储的 Shared-Everything 架构和 XSKY 在多年分布式存储的经验,设计了全新革命性的 eXtreme Shared-Everything Architecture 极速全共享架构(简称为:XSEA、星海架构),它能够充分利用最新的标准存储协议和网络技术,将会颠覆数据中心的存储层次结构,取代部分 NVMe DAS 和混闪存储,通过突破性的方法解决了过去 20 年传统 Shared-Nothing 架构下的性能、可靠性、规模、成本的妥协问题。

星海架构通过的三项技术创新 Shared-Everything、单层闪存介质、端到端的 NVMe,实现了 3 个 100:

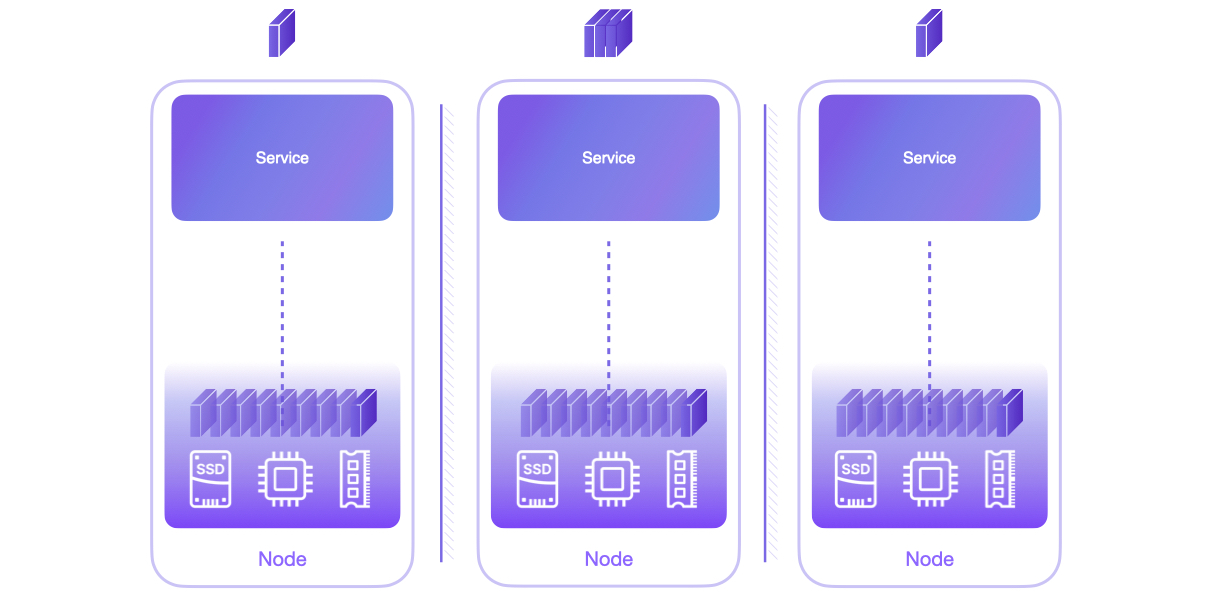

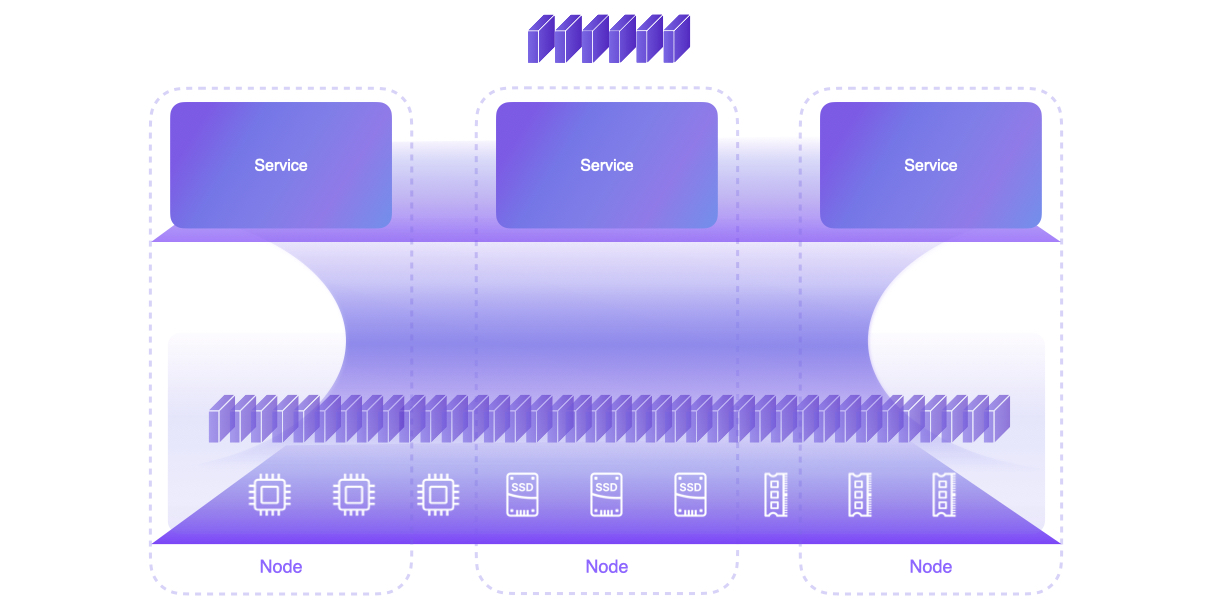

全共享数据存储

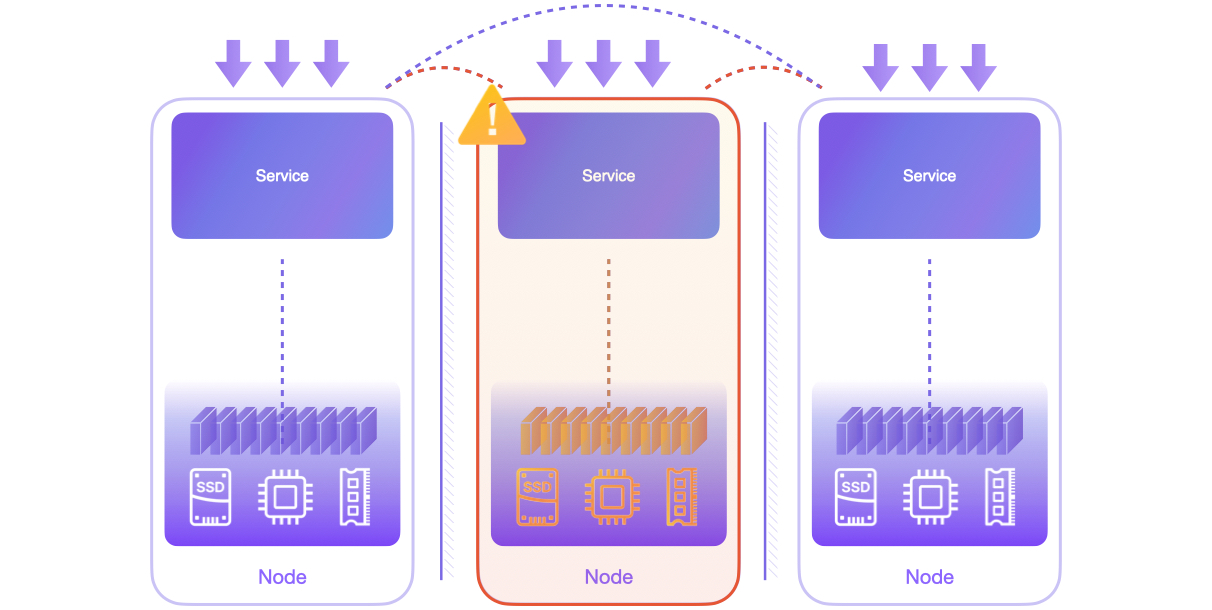

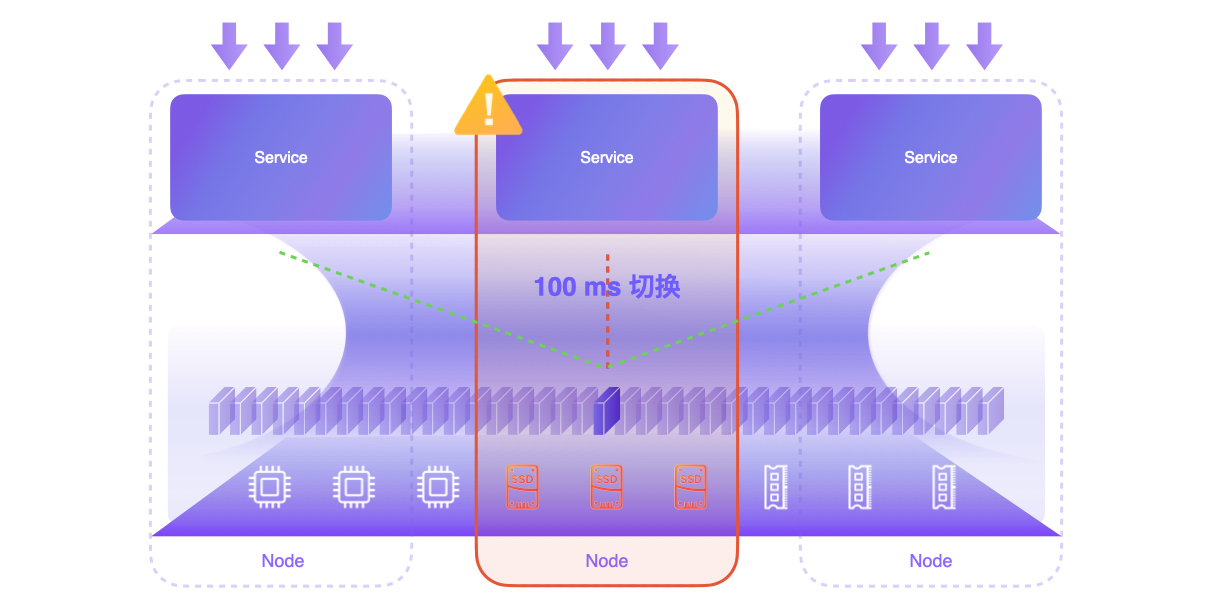

100ms 故障切换时间

面向 TLC NVMe SSD

100% 得盘率

最大化硬件卸载

100µs 超低延迟

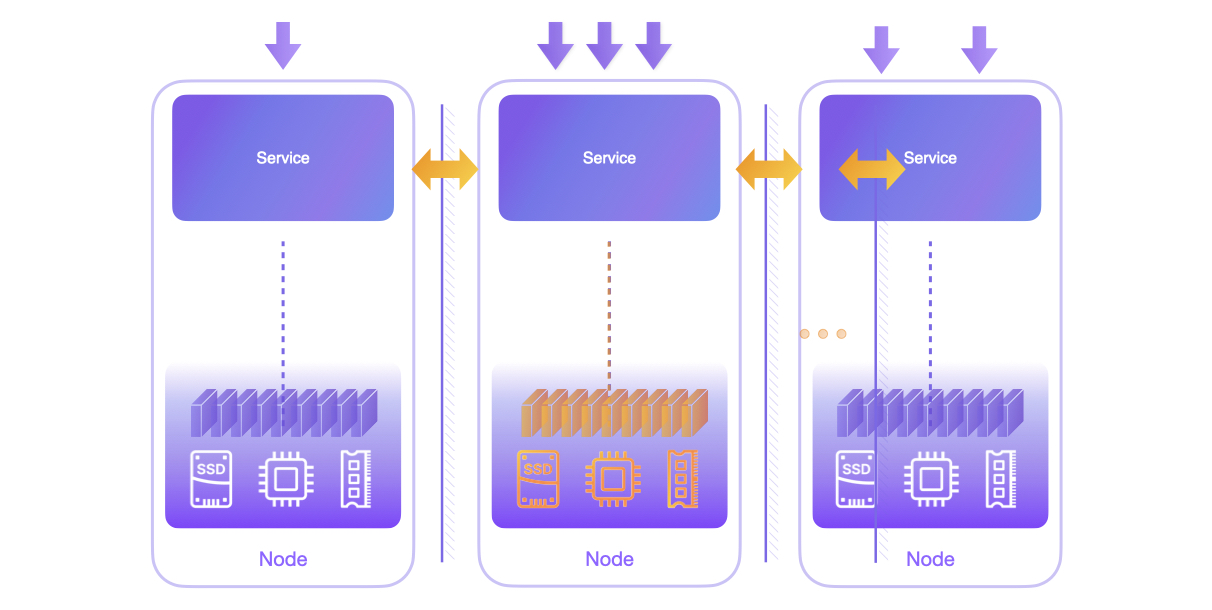

星海架构采用了 “Shared-Everything (全共享)”模型来实现全共享数据存储,使得每个节点都能直接访问所有 SSD,来提高数据访问速度和灵活性。在慢盘、亚健康场景下,可在 100ms 内快速完成故障切换。

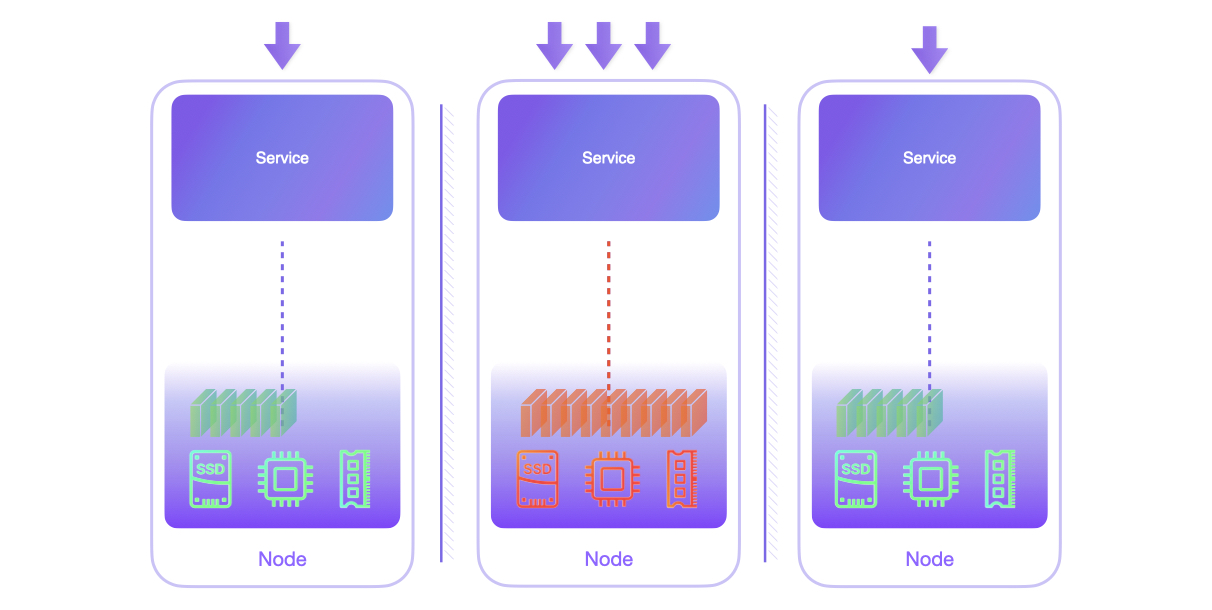

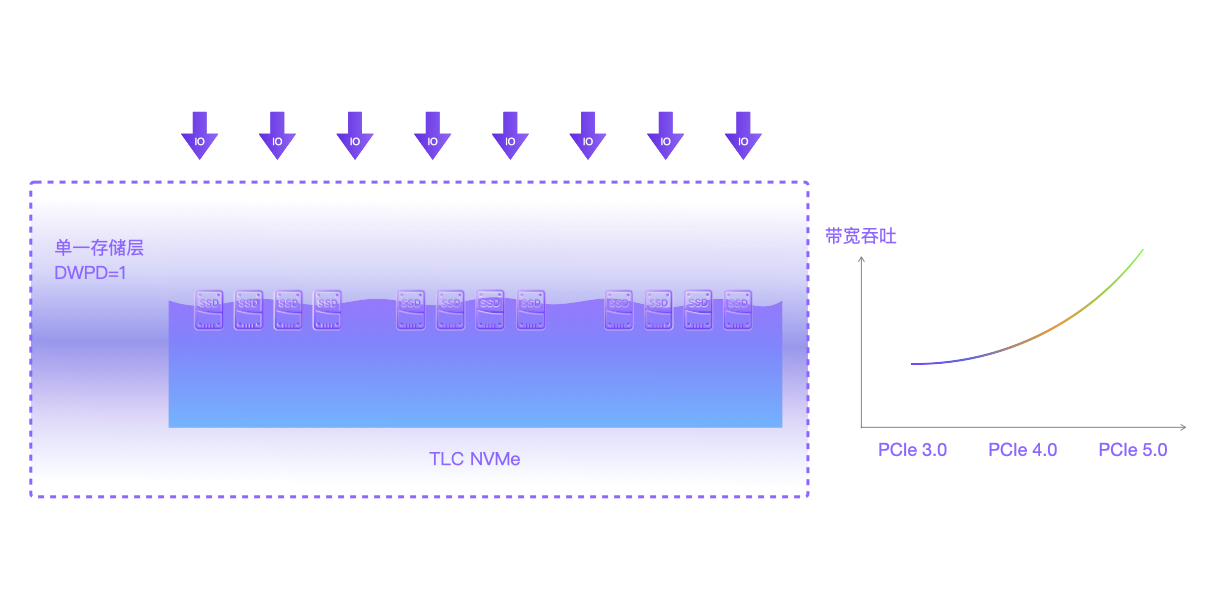

星海架构采用单层 TLC NVMe SSD 来构建存储池,简化集群的存储硬件结构。在使用方式上,利用 Append Only 方式实现数据写入,减少了写放大现象。并通过精心设计的空间布局,在单个 SSD 上实现了缓存和持久存储的双重功能。这些技术使得在没有专用缓存介质情况下,确保足够的性能稳定性。

在常规的混合读写业务场景中,相比分层缓存方式,单层闪存可以显著降低介质成本 20%以上。同时配合 shared-everything 架构模型带来的全局 EC 和压缩功能,使得集群的得盘率超过了 100%。

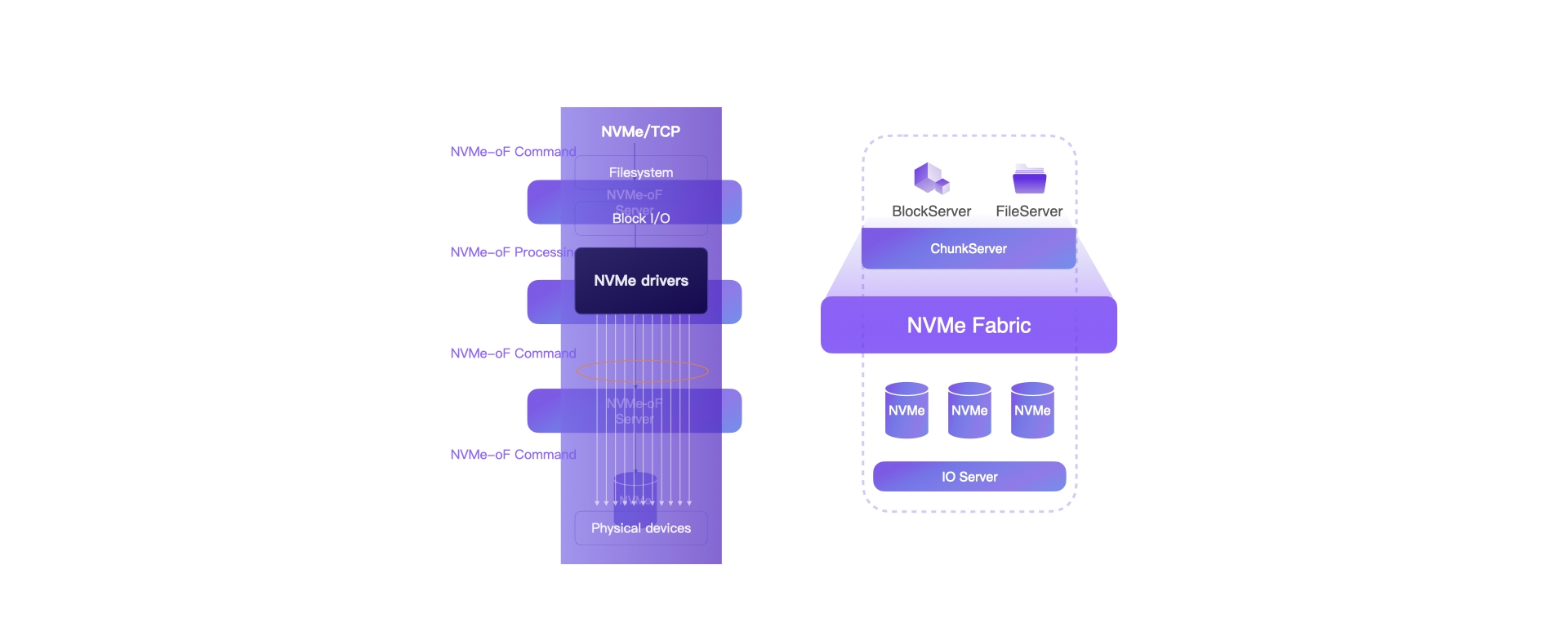

在端到端 IO 路径上,星海架构采用了标准 NVMe over Fabrics 协议进行构建。除了客户端访问存储采用 NVMe over Fabrics 标准协议外,在存储内部互联网络也采用 NVMe over Fabrics 标准协议,是完全的端到端 NVMe 设计,意味着所有存储节点都可以通过 NVMe over Fabrics 高效地访问每一个 NVMe SSD,从而避免了存储协议转换所带来的额外开销。在端到端的 NVMe I/O 路径上,星海架构也采用了高效的 Polling 模式处理每个 I/O 请求,并通过 NUMA 绑定优化了不同服务的内存访问效率,最后实现低至 100 微秒的端到端延迟。这可以让数据中心的任何位置访问星飞全闪存储都只需要微秒级时延。

星飞软件基于星海架构 ,继承了 XSKY SDS 块和文件的成熟能力,提供统一存储平台,为虚拟化、私有云、OLTP、HPDA、AI/ML 等场景提供支持。星飞存储软件的数据面提供了数据持久层、数据服务层、协议访问层,负责数据的存储、保护、安全、呈现,并向客户端主机提供标准存储访问协议。

这三层协同工作提供了下一代分布式全闪存储的以下能力:

数据持久层 Persistent Layer 向上层提供数据持久化服务,拥有 3 个核心设计:

数据服务层 Service Layer 向上层提供块存储服务和文件存储服务,包含 BlockServer、FileServer。

BlockServer 是块存储的存储引擎,基于 Persistent Layer 提供的高性能读写 Chunk 接口,使用 Log-Structured 的形式组织数据抽象出虚拟块层。支持的存储访问协议有 NVMe/RoCE、NVMe/TCP 、iSCSI 和 KVM vhost-blk。

BlockServer 对外提供 NVMe over RoCE/TCP Target 供客户端访问。

BlockDataClient 属于私有客户端,部署在 KVM 计算节点上,为 KVM 提供 vhost-blk 块存储协议接口。

| 英文 | 说明 |

|---|---|

| XINFINI 星飞 | XSKY的新一代全闪技术名称 |

| XSEA 星海 | XSKY的新一代全闪架构名称 |

| eXtreme Shared-Everything Architecture | 缩写是“XSEA”,表示极速全共享架构,即“星海架构” |

| Shared-Everything Architecture | 全共享架构,分布式系统架构的一种 |

| Shared-Nothing Architecture | 无共享架构,分布式系统架构的一种 |

| Persistent Layer | (数据)持久层 |

| Service Layer | (数据)服务层 |

| Access Layer | (协议)访问层 |

| AppendLog Write | 在分布式系统中用于确保数据一致性和容错能力的一种重要技术。 |

| QAT | 英特尔至强可扩展处理器内置的硬件加速器,用于压缩和解压缩操作 |

| NVMe DAS | NVMe direct attached storage, 就是服务器使用本地 NVMe 盘 |

| NVMe | Non-Volatiltee Memory Express,Storage over PCle 协议 |

| RDMA | Remote Direct Memory Access,远程直接内存访问网络协议 |

| CE | Converged Ethernet,无损以太网网络 |

| NVMe-oF Target | NVMe over Fabrics 存储端 |

| NVMe-oF Initiator | NVMe over Fabrics 客户端 |

| RoCE | 代表RDMA Over Converged Ethernet。基于融合以太网的 RDMA (RoCE) ,它允许通过以太网进行远程直接内存访问 (RDMA) |